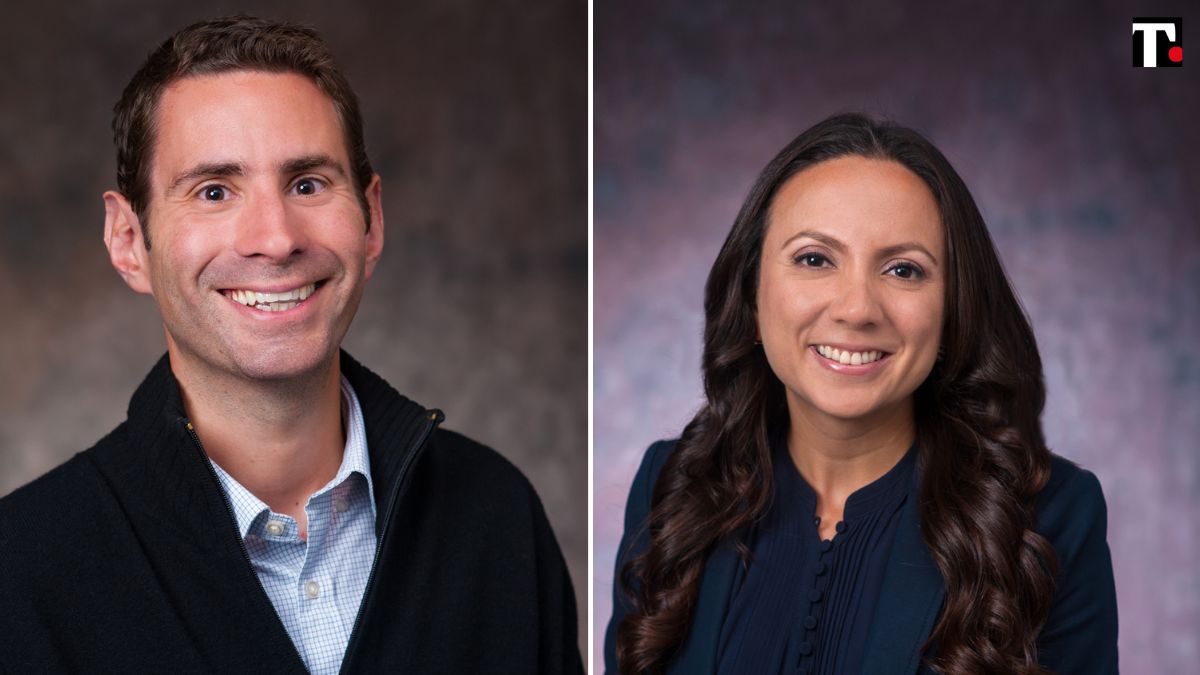

Colloquio di lavoro con il robot? L’immagine al momento è ancora fantascienza, ma vero che è che l’uso dell’intelligenza artificiale nelle selezioni del personale è sempre più diffuso. I recruiter prima o poi non serviranno più? Non è proprio così. A descrivere in un’intervista a True-News.it la situazione attuale e i possibili scenari futuri sono due ricercatori e docenti, che hanno condotto lo studio “Etica nell’IA delle risorse umane: costruire fiducia e attrazione nei processi di reclutamento”, Maria Figueroa-Armijos (EDHEC Business School) e Serge da Motta Veiga (NEOMA Business School).

Selezioni del personale affidate all’AI: quali rischi

“Lasciati a loro stessi, gli strumenti di Intelligenza Artificiale rischiano di perpetuare i pregiudizi incorporati nei loro algoritmi a causa di vari fattori: dipendenza dai modelli storici di assunzione nell’industria, mancanza di consapevolezza da parte dei programmatori e persino manipolazione da parte dei candidati che vogliono ottenere il lavoro”. Per esempio, per superare la selezione iniziale c’è chi ha provato ad inserire a piè di pagina del curriculum una nota nel formato Harvard, in modo da tentare di ingannare la tecnologia, che si basa sull’analisi delle parole chiave inserite nei documenti di testo.

“Poiché gli strumenti abilitati dall’IA raccolgono e utilizzano grandi quantità di dati, sia passati sia attuali, per identificare le persone più indicate per una determinata posizione, potrebbe capitare di veder progredire chi è riuscito a ingannare il sistema oppure di vedere escluso chi non sembra il candidato per quel lavoro secondo una visione storica anziché contemporanea”. Fino a quando non saremo in grado di gestire meglio gli strumenti abilitati dall’IA, insomma, la supervisione umana è essenziale per garantire un processo di assunzione equilibrato, giusto ed inclusivo.

Come utilizzare l’AI nel modo corretto

Come utilizzare allora l’Intelligenza Artificiale da trarne un aiuto, limitandone invece i rischi? “La tecnologia può essere particolarmente efficace nei passaggi iniziali della valutazione, quando si comparano i cv e le lettere di presentazione oppure si fa una prima analisi dei testi delle interviste trascritte, per capire se le qualifiche di un candidato corrispondono con i requisiti minimi richiesti”.

Di fatto, comunque, gli strumenti basati sull’IA possono gestire tutti i diversi aspetti che compongono l’intero processo di recruiting: oltre all’individuazione di una prima rosa di candidati, che può avvenire attraverso applicazioni innovative come TalentSonar e Loxo, prima ancora di questo passaggio anche la stesura di un annuncio di lavoro può essere affidata a strumenti come Careers e Rytr. E ancora, l’Intelligenza Artificiale può analizzare i colloqui video (HireVue), rilevare le abilità cognitive attraverso giochi (Pymetrics), studiare i profili sui social media (Entelo, Manatal), verificare i precedenti penali del candidato (Breezy) e, infine, formulare un’offerta di lavoro (Paradox).

Che cosa ne pensano i team delle risorse umane?

Secondo le statistiche più recenti, quasi l’80% dei selezionatori si aspetta che gli esseri umani non saranno necessari per la selezione dei lavoratori nel prossimo futuro. “Una visione dettata dal constatare quanto gli strumenti di Intelligenza Artificiale comportino un significativo risparmio di tempo e costi e quanta assistenza possano fornire di fronte a grandi quantità di informazioni, ma la mente umana resta essenziale per riconoscere gli errori e l’applicazione di pregiudizi e stereotipi, come si diceva inizialmente”. Infatti, se da un lato le persone dichiarano di avere grande fiducia nell’IA per l’esecuzione di compiti routinari, come la scelta di un film basata sulle preferenze personali, dall’altro lato sono meno propense a fidarsi quando determinati compiti richiedono intuito, empatia e capacità di esprimere un giudizio di valore, caratteristiche strettamente attribuite alla capacità umana, come decidere a chi assegnare o meno un lavoro”.

Come reagiscono i candidati di fronte al colloquio con l’AI?

Nella loro ricerca Maria Figueroa-Armijos e Serge da Motta Veiga hanno scoperto che “i candidati ai colloqui si pongono un problema etico di fronte all’uso degli strumenti abilitati dall’IA, che spesso si ritiene siano piuttosto invasivi”. Per esempio, quando i video dei candidati vengono analizzati per cogliere comportamenti non verbali, come il linguaggio del corpo, oppure quando si analizzano le immagini per individuare determinate caratteristiche facciali, come la tonalità della pelle, oppure quando si rilevano eventuali segnali vocali da un file audio.

Invasivo è ritenuto anche l’uso di dati relativi all’attività sui social media di un candidato, dove spesso vengono pubblicate informazioni personali, che i candidati identificano non rilevanti per il lavoro, come un’eventuale gravidanza, l’affiliazione religiosa e l’associazioni a determinati gruppi sociali o politici. Tutte situazioni che generano una certa diffidenza: “Anche nei casi in cui il candidato teoricamente percepisce l’uso dell’IA come innovativo, nei fatti poi tende a non fidarsi dell’azienda che effettivamente li utilizza nel processo di selezione”.

Come un’azienda può agire correttamente?

Secondo i ricercatori, l’evoluzione dell’IA nella gestione delle risorse umane è inevitabile ed è qualcosa con cui dobbiamo imparare a convivere piuttosto che combattere. “Coloro che imparano a gestire gli strumenti abilitati dall’IA in modo etico ed efficace, sotto la guida e la supervisione degli esseri umani, saranno un passo avanti rispetto a coloro che sono contrari a questa innovazione in generale o che la utilizzano ciecamente senza considerarne gli aspetti dannosi”.

Trovare un equilibrio tra il ruolo dell’uomo e l’IA offrirebbe il vantaggio della precisione, dell’efficienza e dell’oggettività nel processo di selezione, consentendo alle squadre di HR di risparmiare tempo ed energie, che potrebbero essere a quel punto dedicate ad altri obiettivi, tra cui il potenziamento della leadership e la costruzione di relazioni umane più efficaci”.

Che cosa ne pensa ChatGPT

Infine, una curiosità. Maria Figueroa-Armijos e Serge da Motta Veiga hanno chiesto a ChatGPT: “Cosa succederebbe se gli esseri umani non fossero più necessari e fossero sostituiti da robot nel reclutamento di dipendenti?”.

Ecco la risposta del famoso programma, che sembra allinearsi con la tesi dei ricercatori.

“Ciò potrebbe avere diverse implicazioni. Ecco alcune possibili conseguenze:

efficienza e velocità: i robot possono elaborare grandi quantità di dati in modo rapido ed efficiente, portando potenzialmente a processi di assunzione più veloci e efficienti;

pregiudizi ed equità: sebbene i robot possano essere meno suscettibili a certi pregiudizi, c’è il rischio che possano ereditare pregiudizi presenti nei dati usati per addestrarli. Garantire l’equità e evitare la discriminazione negli algoritmi di assunzione sarebbe cruciale;

mancanza di intuito umano: il tocco umano, l’empatia e l’intuizione giocano un ruolo significativo nella comprensione dei candidati al di là delle loro qualifiche. fidarsi solo dei robot potrebbe comportare una mancanza di comprensione sfumata della personalità e delle soft skills dei candidati;

preoccupazioni per la disoccupazione: l’ampio utilizzo di robot nel reclutamento potrebbe portare a una dislocazione lavorativa per i reclutatori umani. Ciò potrebbe sollevare preoccupazioni sulla disoccupazione e sulla necessità di riqualificare la forza lavoro per nuovi ruoli;

considerazioni etiche: l’uso dei robot nei processi decisionali, specialmente in aree cruciali come l’occupazione, solleva questioni etiche. Assicurare trasparenza, responsabilità e uso responsabile della tecnologia diventa fondamentale.

sfide tecniche: sviluppare e mantenere sistemi AI sofisticati per il reclutamento richiederebbe avanzamenti tecnici continui, e potrebbero sorgere sfide nel tenere il passo con le tecnologie in evoluzione.

In sintesi, mentre l’automazione dei processi di assunzione può offrire vantaggi in termini di efficienza, pone anche sfide legate all’equità, alla comprensione umana e alle considerazioni etiche. Un approccio bilanciato che combina i punti di forza della tecnologia con il giudizio umano potrebbe essere la soluzione più efficace”.